日期:2023-08-28 点击数:2240

PICO最新更新SDK 2.3.0版本和OS 5.7.0版本,现已加入MR环境感知技术,支持开发独特的MR应用和游戏!

PICO SDK 2.0系列已经和各位开发者朋友们见面有将近2年时间了。在这段难忘的时间里,我们进行了12次更新,支持了400+款应用在PICO上的流畅运行。我们通过SDK出色的使用性和兼容性,发挥了PICO系列设备的性能优势和稳定性优势,也得到了Paul Brady (Resolution Games) 以及Alastair Burns (Vertigo Studios Rotterdam) 等开发者的肯定。

从这个版本起,我们把SDK中有关MR环境感知的能力集称为Sense Pack。基于Sense Pack全新的空间标定和空间锚点支持,开发者可以正式开始尝试开发自己的MR应用了!希望从这一刻起,我们有幸和你一起,和我们不断进化的XR平台一起前行。让我们从混合现实开启想象力,一起享受通往无限的旅程吧。

本次版本更新重点内容:

Sense Pack发布“空间标定”与“空间锚点”功能,这些功能的发布可以将真实世界中的物体和场景与虚拟世界进行交互,使用户可以在虚拟的环境中感受到真实的物理世界。

渲染新增“眼动追踪注视点渲染”功能,可以根据用户的注视点进行渲染,节省 GPU 负载。

追踪能力四项更新,“人体追踪”功能新增 “全身动捕” (全身追踪)模式,可以实现实时的收集用户的身体位置和动作信息,从而为虚拟现实应用程序提供更加精确和自然的动作和姿态;“面部追踪”新增融合驱动(Hybrid Blendshapes) 模式,准确还原用户面部变化;“手势追踪”功能优化了智能算法和手部模型,全面对标OpenXR标准,同时新增支持Unity可视化手势编辑;“原点追踪”新增设置和获取原点追踪模式接口(仅 Unity)。

平台服务新增 “高光时刻” 服务,记录和分享用户在应用内的精彩时刻;新增 “语音转文字” 服务,可实现60秒语音实时转换为文字。

以下是本次更新重点功能介绍:

Room Capture 是 PICO 提供的系统级空间标定应用,用户可以通过此应用将现实空间中的墙、门窗、桌椅、沙发等物体进行标定,用于与应用内的虚拟物体进行交互。你可以通过 SDK 获取 Room Capture 创建的空间和标定数据用于自己的应用中。

PICO 空间标定功能采用了 “AI 辅助空间标定” 技术,融入了边线和角点的识别算法,可以让头戴主动识别并推荐边线。目前已支持识别墙体和天花板的边线,可以快速识别并为用户智能推荐更加精准的位置,减少手动标定中的反复调整和对齐工作。之后还会覆盖门窗、更多家具的识别感知,让用户更轻松地完成空间标定。

参阅我们的开发文档(Unity / Unreal),了解更多空间标定相关信息。

功能展示视频

空间锚点技术可以将虚拟环境中的位置与真实世界中的位置进行锚定,用于将虚拟对象锚定到现实世界的位置或物体上。锚定后,使用同一设备多次进入相同的空间后,都可以在锚点位置看到虚拟物体。

参阅我们的开发文档(Unity / Unreal),了解更多空间锚点相关信息。

Demo视频

这一功能允许你将你自己应用中的界面放置到现实位置中,并将其锚定在特定点,同时通过你的应用创意,来看看如何能够让自己的界面和现实位置发生实际的交互。

从这个版本起,基于以上两项技术提供的环境感知技术的支持,开发者可以运用SDK和Unity/Unreal引擎,正式开始尝试开发自己的MR应用了!

眼动追踪注视点渲染(Eye Tracked Foveated Rendering,ETFR)功能,根据用户眼球的注视方向,以全分辨率渲染眼球注视区域的图像,以低分辨率渲染非注视区域图像,从而降低应用运行时设备的GPU负载。

ETFR需要配合眼动追踪摄像头使用,随着眼球的移动,全分辨率渲染区域也会相应地变化,从而使用户获得更加真实和清晰的视觉体验。

该功能仅支持搭载眼动追踪摄像头的PICO设备,包括PICO Neo3 Pro Eye、PICO 4 Pro和PICO 4 Enterprise。

参阅我们的开发文档(Unity / Unreal),了解更多眼动追踪注释点渲染相关信息。

ETFR功能示意图(仅供参考)

人体追踪是一种动作捕捉技术,通过收集用户的身体位置和动作信息,并将其转换为可再现的姿态数据。人体追踪技术能够支持用户在 VR 场景中进行跑、踢、踩等动作,丰富用户的动作体验。

PICO 的人体追踪功能需要结合 PICO 体感追踪器进行使用。PICO 体感追踪器是一款运动追踪配件,可以获取用户身体位置和动作信息。

本次更新,我们提供了全新的全身追踪模式,你可调用相关接口切换至该模式,实时捕捉用户身体各个部位的动作信息,为虚拟现实应用程序提供更加真实和自然的用户体验。

参阅我们的开发文档(Unity / Unreal),了解更多人体追踪相关信息。

PICO 4 Pro 系列一体机安装了面部追踪相机,可检测和捕捉用户的面部表情。在本次更新中,面部追踪在原有的 3 种模式上,新增了融合驱动(Hybrid Blendshapes) 模式,适用于没有制作 Viseme 的美术素材,驱动 Avatar 面部更精准。

同时,本次更新我们还重构了面部追踪和眼动追踪相关接口,调用流程更加清晰。

参阅我们的开发文档(Unity / Unreal),了解更多面部追踪相关信息。

面部追踪功能示意

本次版本更新我们对手势识别进行了全面升级,为你的应用带来令人惊喜的改进。通过优化智能算法和手部模型,我们实现了更出色的手势交互体验。

更准确的手指追踪:我们精心优化了手指追踪,能够精准地捕捉和还原用户的手部姿势。无论是细微的手指动作还是复杂的手势,你的应用都能以更高的准确性呈现。

智能遮挡判断:此次算法优化能够更智能地识别手部遮挡情况,特别是在双手重叠的场景下。这意味着我们能够更好地处理可能出现的异常状态,确保手势追踪在各种情况下的稳定性和准确性。

自然的虚拟手表现:我们对虚拟手进入和离开头戴设备视野范围的表现进行了改进。现在,虚拟手的显示和消失更加自然,为用户带来更流畅的交互体验。

稳定的轨迹追踪:不论是头部还是手部的快速运动,全新升级的手势追踪都能够保持稳定,准确地还原手部位置。

特别提示,此次手势追踪算法升级,我们已对标OpenXR标准。新版手势追踪功能已不兼容旧版SDK,请使用2.3.0版本的SDK以及5.7.0版本的PICO设备系统进行应用开发。

参阅我们的开发文档(Unity / Unreal),了解更多手势追踪相关信息。

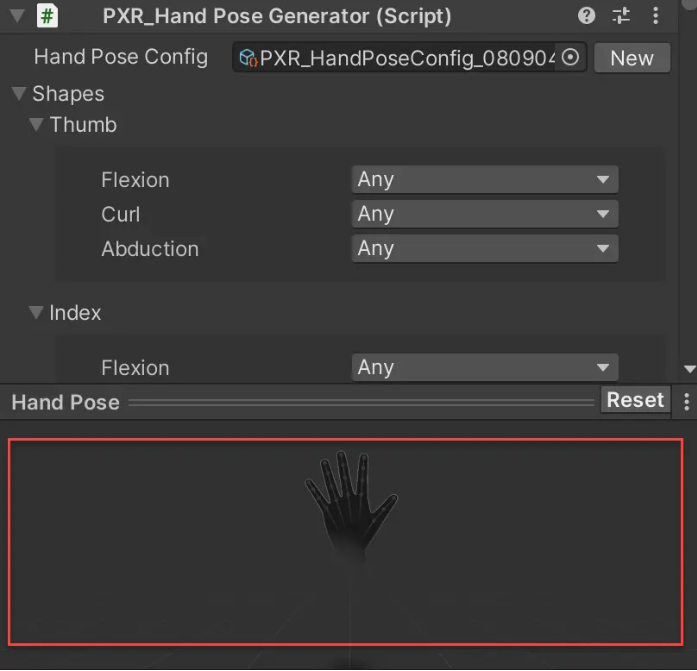

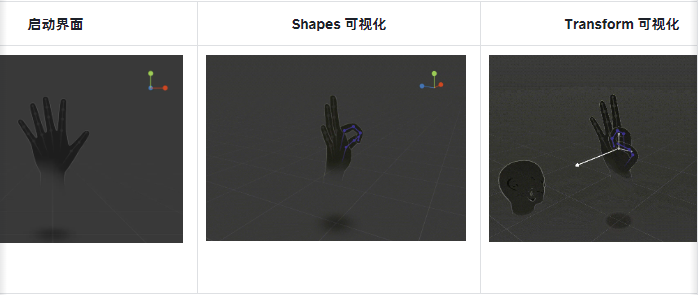

开发者可以在Unity编辑器内使用PICO的HandPoseGenerator预制体,轻松创建和编辑手势配置文件。通过设置Shapes、Bones和Transform,你可以根据自己的需求定制手势,并快速将文件挂载至预制体或其他GameObject的PXR_HandPose脚本上进行使用。

在编辑过程中,你可以在Inspector窗口中实时预览手势的效果。这意味着你可以即时调整手势的形状、骨骼和变换,以精确捕捉所需的手势动作。

功能预览图

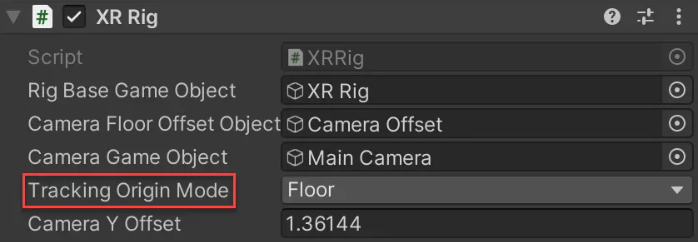

你可以轻松为你的应用设置原点追踪模式:

设置截图(详细步骤见开发文档)

同时,我们还提供了获取应用原点追踪模式的接口。通过调用PXR_System.GetTrackingOrigin接口,你可以方便地获取应用当前使用的原点追踪模式。

参阅我们的开发文档,了解更多原点追踪相关信息。

高光时刻(Highlights)服务用于记录用户使用应用过程中的精彩时刻,并将这些时刻以图片或视频的形式保存下来,供用户回顾和分享。

参阅我们的开发文档(Unity / Unreal),了解更多“高光时刻”服务相关信息。

功能截图

语音转文字服务,应用自动语音识别技术(ASR),可以实时识别语音信息,将其转化为文本。支持中英文,60秒内的语音即刻转换,方便快捷。

参阅我们的开发文档(Unity / Unreal),了解更多“语音转文字”服务相关信息。

以上为PICO SDK 2.3.0版本中的部分更新内容。若想查看完整的更新内容,请阅读 SDK 2.3.0版本更新说明(Unity / Unreal)。

希望全新的PICO SDK 2.3.0版本能助力你的PICO应用开发之旅,你可以前往 SDK 下载中心下载该版本,参阅我们的开发文档,了解更多信息。

关注公众号回复“进群”即可加入群聊

主办单位:深圳市增强现实技术应用协会

地址:深圳市宝安区兴东社区南天辉创研中心6楼

电话:18938893801 Email:Vip@szar.org.cn

《中华人民共和国电信与信息服务业务经营许可证》编号: 粤ICP备18013217号

关注微信公众号

手机查看